Contesto

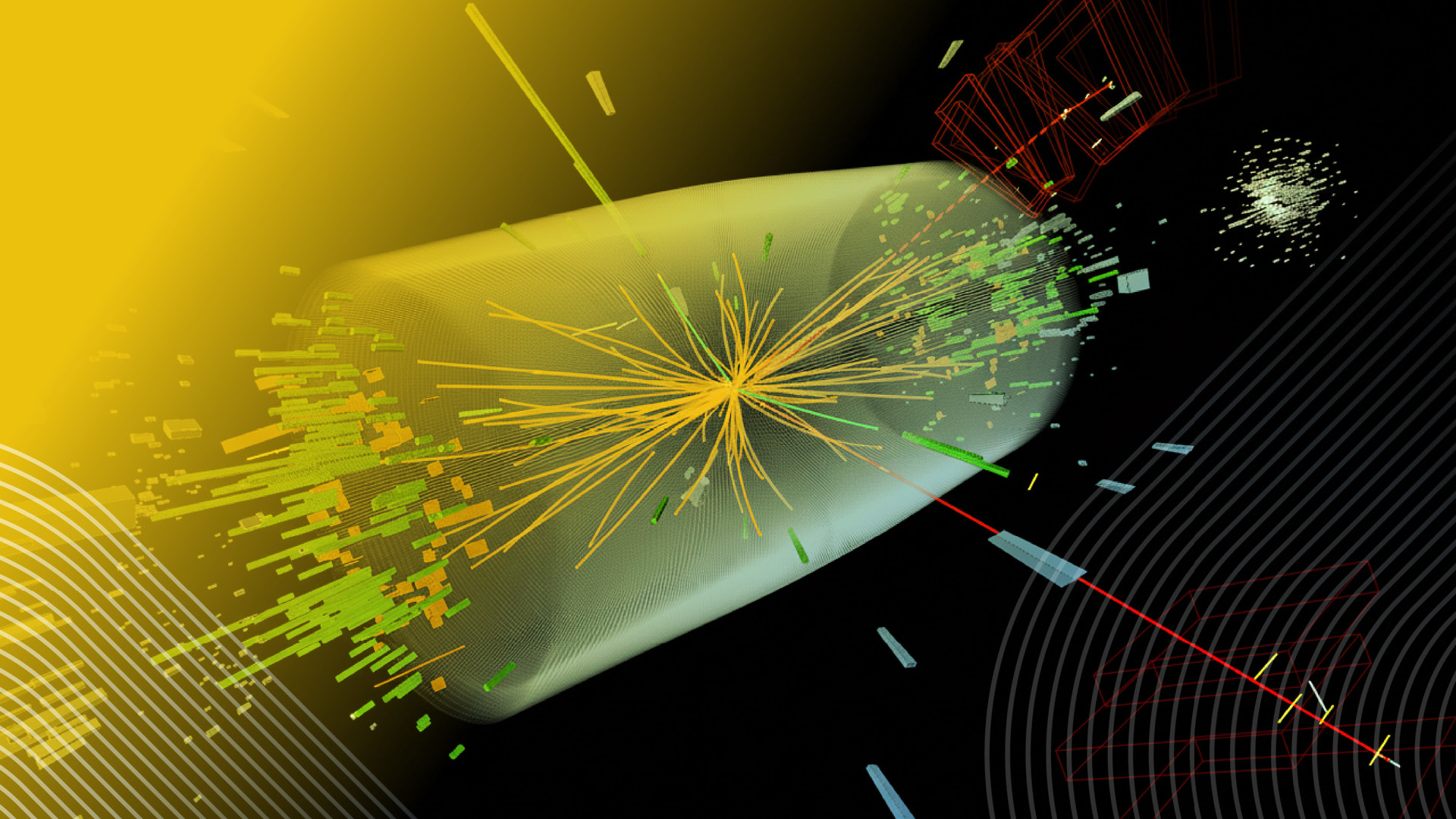

Lo Spoke opera all’intersezione tra High-Performance Computing, scienza data-intensive e sviluppo di algoritmi, affrontando esigenze relative alla simulazione, ricostruzione e analisi dati in QCD su reticolo, fisica dei collisori, cosmologia, astroparticelle e astrofisica multimessaggera e facendo ricorso ad architetture massivamente parallele e metodi di AI.

In questo contesto un’importanza cruciale è svolta dalla capacità di: ottimizzare codici su GPU e sistemi eterogenei; gestire grandi moli di dati in architetture distribuite; fornire strumenti trasversali standard come framework statistici e tool per le analisi ad alta intensità dei dati. Attività grazie alle quali supportare sia gli esperimenti di frontiera sia i casi d’uso industriali che condividono esigenze di calcolo, archiviazione e throughput.

Obiettivi

- Sostenibilità del calcolo per la Big Science: mantenere prevedibili le necessità di calcolo riducendo il costo delle singole operazioni tramite acceleratori, architetture eterogenee e modelli di data-lake ottimizzati per lo storage.

- Efficienza e prestazioni: progettare algoritmi e pipeline che riducano i tempi di esecuzione grazie a GPU e FPGA, parallelismo massivo e tecniche di Machine Learning.

- Scalabilità scientifica: sviluppare codici e workflow per analisi ad alta intensità che scalino su decine di migliaia di core e che siano validati su piattaforme e domini eterogenei validazione.

- Trasferibilità: standardizzare strumenti e metodologie per favorire il riuso in ambito industriale, in particolare nei casi d’uso della Space Economy.

- Responsabilità e formazione: associare a ogni caso d’uso target e KPI misurabili e diffondere competenze tramite corsi, workshop, repository software e report pubblici o interni.

Attività

Le attività di Spoke 2 combinano sviluppo scientifico e ingegneria del software su infrastrutture eterogenee. Sul fronte della simulazione e dell’analisi dati, i WP scientifici sviluppano codici scalabili, pipeline distribuite e trigger intelligenti su FPGA per selezionare eventi di interesse. In parallelo, i WP tecnici si concentrano sull’ottimizzazione di codici GPU, sul bilanciamento tra throughput e costo energetico e sulla gestione di data-lake ad alta capacità, così da ridurre la latenza di accesso e garantire la portabilità dei workflow. La validazione e il riuso sono favoriti da framework statistici condivisi, dalla documentazione dei casi d’uso e dalla pubblicazione di software e dataset di test, assicurando la tracciabilità dei risultati e l’adozione in domini contigui.

Collaborazione pubblico–privato e applicazioni abilitate

La collaborazione con partner industriali svolge il ruolo di leva strutturale per rendere sostenibili e riutilizzabili nel tempo le soluzioni sviluppate. Le stesse tecnologie che ottimizzano il budget computazionale della “Big Science” (eterogeneità hardware, data-lake distribuiti, algoritmi efficienti, uso esteso dell’AI) trovano applicazione nell’ambito della Space Economy, della visione artificiale e della data analytics. I partner contribuiscono con casi d’uso concreti e beneficiano di formazione avanzata su HPC, AI e cloud, oltre all’accesso a metodologie validate in contesti sperimentali che richiedono elevate prestazioni.

Ricadute

Le soluzioni sviluppate riducono la barriera d’accesso all’HPC per imprese e Pubblica Amministrazione, mettendo a disposizione infrastrutture e competenze nate per esperimenti di frontiera e adattate a contesti produttivi. La formazione erogata su architetture eterogenee, calcolo distribuito e Machine Learning crea capitale umano qualificato, spendibile tanto nei laboratori quanto nelle aziende hi-tech e nelle start-up legate allo spazio. La pubblicazione di codici, dataset e white paper favorisce la verifica indipendente e il riuso, mentre la sostenibilità del calcolo scientifico contribuisce alla competitività internazionale del sistema della ricerca e innovazione e di quello produttivo, traducendosi in un incremento della qualità dei servizi e dell’attrattività di investimenti in settori data-intensive e spaziali.

Referenti

Leader: Sandra Malvezzi (sandra.malvezzi@mib.infn.it), Tommaso Boccali (tommaso.boccali@pi.infn.it)

Co-leader: Antonio Stamerra (antonio.stamerra@inaf.it)

Istituzione leader

Istituzione leader

Istituzione co-leader

Enti e Università

Aziende